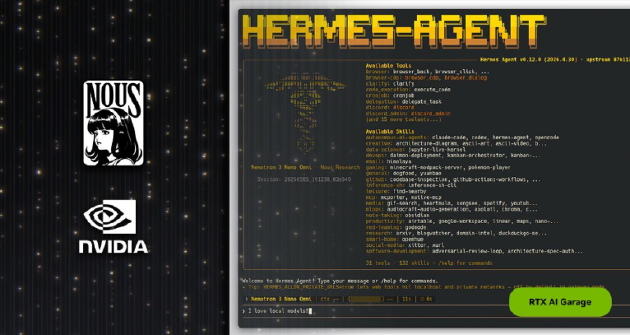

代理式 AI 正在改变用户完成工作的方式。继 OpenClaw 取得成功之后,社区正积极拥抱新的开源代理式框架。最新框架是 Hermes Agent,在不到 3 个月内突破 140,000 GitHub 星标。截至上周,根据 OpenRouter 的数据,它已成为全球使用量最高的智能体。

Qwen 3.6 是阿里巴巴推出的新一代高性能开放权重大语言模型(LLM)系列,非常适合运行 Hermes 这样的本地智能体。Qwen 3.6 27B 和 35B 参数模型的表现超过了上一代 120B 和 400B 参数模型,并可在 NVIDIA RTX 与 DGX Spark 上运行,为代理式 AI 提供加速。

Hermes:加速本地 AI 智能体能力

与其他热门智能体一样,Hermes 可集成消息应用,访问本地文件和应用,并全天候 24 小时运行。但以下 4 项突出能力让它脱颖而出:

Hermes 智能体和底层 LLM 都为本地运行而构建,这意味着硬件质量将直接决定用户体验质量。NVIDIA RTX GPU 正是为这类工作负载而打造。

Qwen 3.6:在本地提供数据中心级智能

最新 Qwen 3.6 模型基于广受认可的 Qwen 3.5 系列打造,为本地 AI 智能体带来又一次飞跃。全新 Qwen 3.6 35B 模型可在约 20GB 内存上运行,同时生成结果超越需要 70GB 以上内存的 120B 参数模型。

Qwen 3.6 27B 是一款新的稠密模型,拥有更多活跃参数,在仅为 Qwen 3.5 397B 等 400B 参数模型 1/16 大小的同时,达到相似的准确率。高端 RTX GPU 可为该模型提供实现高速体验所需的计算能力。

DGX Spark:始终在线的代理式计算机

Hermes 这样的智能体专为持续运行而构建,可以响应请求、规划多步骤任务、自主执行并自我改进。NVIDIA DGX Spark 是理想搭档,它是一台紧凑、高效的独立设备,专为持续全天候代理式工作流而打造。

128GB 统一内存和 1 petaFLOP AI 性能让 NVIDIA DGX Spark 可全天运行 120B 参数混合专家模型。而全新 Qwen 3.6 35B 模型以更精简的占用空间提供同等智能,不仅运行速度更快,还让用户有能力运行并发工作负载。

开始在 NVIDIA 硬件上使用 Hermes

在 NVIDIA 硬件上本地运行 Hermes 非常简单。

无论是探索个人智能体前沿的本地 AI 爱好者,还是为自身工作流构建本地工具的开发者,NVIDIA 硬件上的 Hermes 都能提供独特强大且可靠的基础。

敬请关注 RTX AI Garage,了解针对 NVIDIA RTX 硬件优化的最新开放模型和智能体的更多更新。

#别错过:NVIDIA RTX AI Garage 最新动态

✨ NVIDIA RTX PRO GPU 在运行 Qwen 3.6 模型与 llama.cpp 时,可实现最高 3 倍更快的 token 生成速度。它可为本地 AI 提供所需的实时响应能力,让智能体处理多步骤任务并改进自身技能,从而保持工作流顺畅无缝。

Google Gemma 4 26B 和 31B 模型现已推出 NVFP4 checkpoint,可在 NVIDIA Blackwell GPU 上实现更快性能。将 NVFP4 checkpoint与 Google 全新 Multi-Token Prediction 草稿模型搭配使用,可在相同输出质量下实现最高 3 倍更快推理,让前沿级推理能够在 NVIDIA GPU 上本地运行。

Mistral Medium 3.5 版已于 4月发布,包含与 llama.cpp 和 Ollama 的兼容性更新,使用户能够在 NVIDIA RTX PRO 和 DGX Spark 系统上运行。

? NVIDIA 最近推出了 NVIDIA NemoClaw,这是一个可通过增强安全性和支持本地模型的开源堆栈,在 NVIDIA 设备上优化 OpenClaw 体验。NemoClaw 现已支持 Windows Subsystem for Linux(WSL2),为微软平台上的爱好者和开发者带来支持。开始在 DGX Spark 上使用 NemoClaw,请查看 Playbook。

NVIDIA RTX AI PC 的相关信息请关注微博、抖音及哔哩哔哩官方账号。

软件产品信息请查看声明。

热门资讯

HOT NEWS

热门视频

HOT VIDEOS

原创推荐

Original